Ty decydujesz, skąd pochodzi wiedza

AI potrafi odpowiadać logicznie i przekonująco. Pytanie brzmi: na jakiej podstawie? Im większą rolę odgrywa w procesach firmy, tym ważniejsza staje się kontrola nad źródłami wiedzy i kontekstem działania. Dojrzałe wdrożenie nie zaczyna się od funkcji, lecz od zasad, ról i odpowiedzialności. Bez tego nawet najlepsza technologia nie zbuduje zaufania ani realnej wartości biznesowej.

Kiedy AI odpowiada logicznie, spójnie i całkiem sensownie, naturalnym odruchem powinno być kolejne pytanie: a skąd pochodzi ta wiedza?

To moment, w którym organizacja mówi „sprawdzam”. Nie po to, by podważać technologię, lecz by upewnić się, że jej odpowiedzi są osadzone w właściwym kontekście. Bo w środowisku biznesowym nie chodzi wyłącznie o poprawność językową czy logiczną konstrukcję wypowiedzi. Chodzi o źródło informacji.

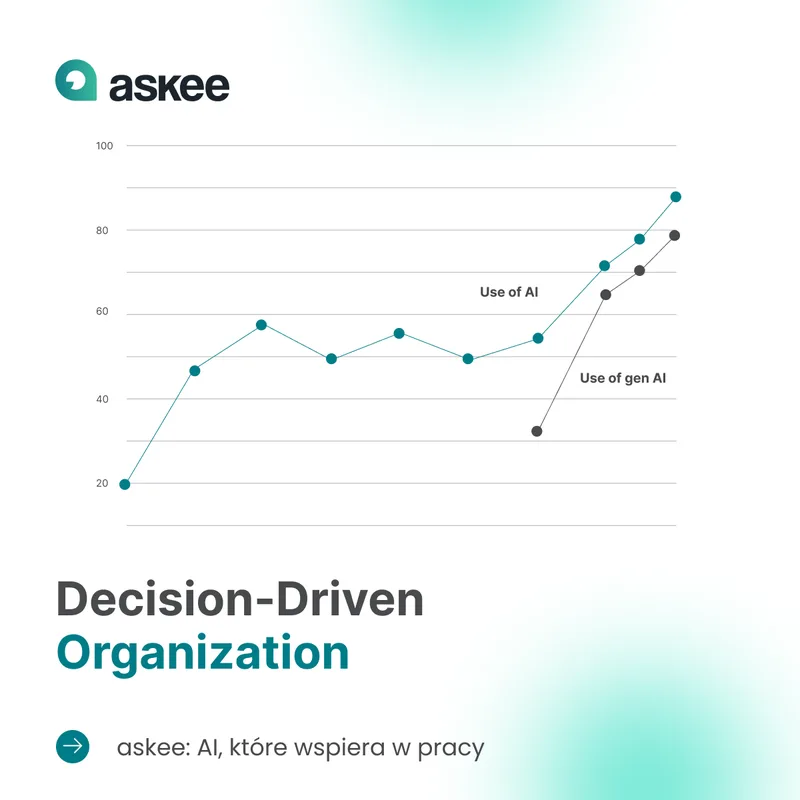

Im szerzej asystent AI wspiera procesy w firmie – od komunikacji wewnętrznej, przez analizę danych, po rekomendacje decyzyjne – tym większe znaczenie ma kontrola nad tym, na jakiej wiedzy pracuje.

Raport Deloitte „State of AI in the Enterprise” wskazuje, że jedną z głównych barier skalowania AI w organizacjach jest jakość i dostępność danych oraz brak zaufania do wyników generowanych przez modele. Z kolei badania IBM Institute for Business Value pokazują, że firmy osiągające najwyższy zwrot z inwestycji w AI dużo częściej wdrażają formalne mechanizmy zarządzania danymi i nadzoru nad modelami. Innymi słowy – technologia to jedno, ale governance i kontrola źródeł to warunek realnej wartości biznesowej.

Dojrzałe wdrożenie AI nie zaczyna się więc od listy funkcji. Zaczyna się od odpowiedzi na kilka kluczowych pytań:

Jakie dane są źródłem prawdy w naszej organizacji?

Kto odpowiada za ich aktualność?

W jakim zakresie asystent może z nich korzystać?

Czy jego rekomendacje są zgodne z przyjętymi rolami i odpowiedzialnościami?

Bez tych ram AI może generować poprawne, lecz nieadekwatne odpowiedzi. Może brzmieć przekonująco, ale działać poza kontekstem organizacyjnym. A to w dłuższej perspektywie podważa zaufanie – zarówno menedżerów, jak i pracowników.

Dlatego askee działa inaczej.

Nie korzysta z niekontrolowanej, ogólnej wiedzy jako podstawy decyzji operacyjnych. Opiera się na źródłach świadomie zdefiniowanych przez użytkownika. Działa zawsze w kontekście roli i odpowiedzialności. To oznacza, że odpowiedź nie jest tylko „logiczna” – jest zgodna z zasadami konkretnej organizacji.

W praktyce oznacza to większą przejrzystość, spójność decyzji i realne wsparcie menedżerów. AI nie zastępuje odpowiedzialności człowieka, ale działa w jasno określonych ramach. A to właśnie te ramy budują zaufanie.

Bo w biznesie najważniejsze pytanie wobec AI nie brzmi: „czy potrafi odpowiedzieć?”.

Brzmi: „czy wiemy, na jakiej podstawie odpowiada?”