Dlaczego „uniwersalny asystent AI” nie istnieje?

Dlaczego „uniwersalny asystent AI” nie istnieje? Bo organizacje nie są uniwersalne. To samo pytanie w firmie X może oznaczać zupełnie coś innego dla specjalisty HR, menedżera operacyjnego i administratora systemu. „Jak wygląda proces akceptacji wydatku?” – dla jednej osoby oznacza instrukcję krok po kroku, dla drugiej – podgląd statusu budżetu, dla trzeciej – kontrolę zgodności z polityką finans...

Dlaczego „uniwersalny asystent AI” nie istnieje?

Bo organizacje nie są uniwersalne.

To samo pytanie w firmie X może oznaczać zupełnie coś innego dla specjalisty HR, menedżera operacyjnego i administratora systemu. „Jak wygląda proces akceptacji wydatku?” – dla jednej osoby oznacza instrukcję krok po kroku, dla drugiej – podgląd statusu budżetu, dla trzeciej – kontrolę zgodności z polityką finansową.

Ta sama procedura ma różne znaczenie w zależności od roli, odpowiedzialności i momentu, w którym ktoś realizuje swoje zadania.

Uniwersalny asystent AI musiałby te różnice uprościć albo zignorować. A w organizacji to właśnie niuanse decydują o jakości decyzji.

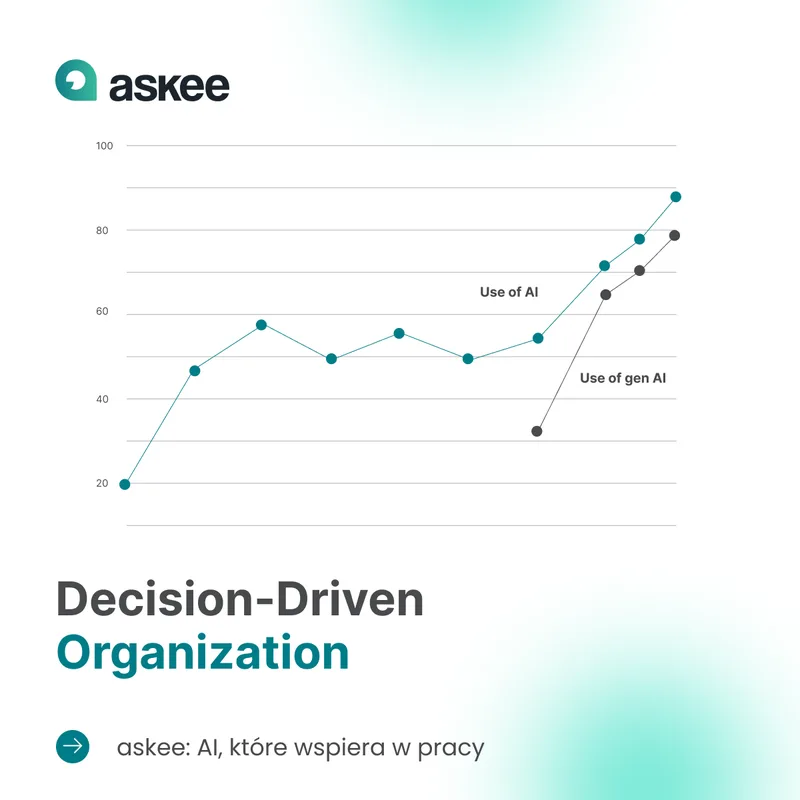

Z raportu McKinsey & Company „The State of AI 2025” wynika, że firmy osiągające najwyższą wartość z wdrożeń AI personalizują systemy pod kątem konkretnych ról i procesów biznesowych. Tam, gdzie AI działa w sposób ogólny i oderwany od struktury organizacyjnej, wpływ na wyniki finansowe i produktywność jest wyraźnie niższy.

Podobne wnioski przynosi raport Deloitte „Tech Trends 2025”, który podkreśla, że kontekst organizacyjny – w tym struktura odpowiedzialności i specyfika procesów – jest kluczowym czynnikiem sukcesu projektów AI. Technologie oparte na modelach ogólnych wymagają warstwy adaptacyjnej, która osadza je w realiach konkretnej firmy.

W praktyce oznacza to jedno: problemem nie jest brak odpowiedzi. Problemem jest brak właściwej odpowiedzi w danym momencie – odpowiedzi dopasowanej do osoby, która pełni określoną rolę w określonym kontekście.

Menedżer nie potrzebuje tej samej informacji, co specjalista operacyjny. Administrator systemu nie powinien widzieć ani interpretować danych w taki sam sposób jak pracownik liniowy. Jeśli AI odpowiada wszystkim tak samo, wprowadza uproszczenie, które może prowadzić do błędnych decyzji.

Dodatkowo raport Gartner z 2025 roku wskazuje, że jednym z głównych wyzwań wdrożeń generatywnej AI jest brak dopasowania odpowiedzi do kontekstu użytkownika i poziomu jego odpowiedzialności. Organizacje, które nie uwzględniają różnic ról w projektowaniu systemów AI, częściej raportują spadek zaufania do narzędzi.

Dobry asystent AI w firmie nie powinien być uniwersalny.

Powinien być kontekstowy.

Powinien rozumieć:

– kto pyta,

– w jakiej roli działa,

– jakie ma uprawnienia,

– na jakim etapie procesu się znajduje,

– jaki jest cel jego działania.

To oznacza odejście od myślenia o AI jako o „wszechwiedzącym doradcy”, a przejście do modelu asystenta osadzonego w strukturze organizacyjnej.

Właśnie z takiego założenia powstało askee.

To nie jest system, który odpowiada identycznie każdemu użytkownikowi. askee działa w kontekście roli, projektów, zadań i zasad obowiązujących w firmie. Rozumie, że to samo pytanie może mieć różne znaczenie w zależności od miejsca w strukturze.

Dzięki temu odpowiedź nie jest tylko poprawna językowo. Jest adekwatna operacyjnie.

W świecie, w którym AI staje się coraz bardziej dostępna, prawdziwą przewagą nie jest uniwersalność. Przewagą jest dopasowanie.

Uniwersalny asystent AI brzmi atrakcyjnie marketingowo.

Ale w realnej organizacji wartość tworzy system, który rozumie różnice – i działa zgodnie z nimi.